Bonjour à tous,

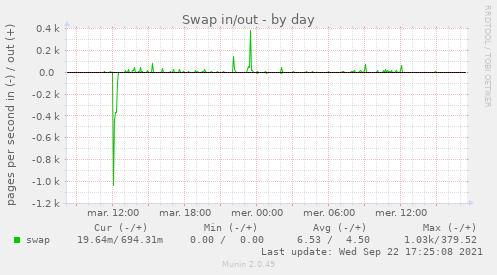

Récemment, suite à la lecture de ceci : https://www.le5emeaxe.fr/proxmoxetswap-2/ et au constat que le notre serveur proxmox du Retzien SWAPai tôt… j’ai changé le vm.swappiness du serveur à 10 (avant à 60). Chez lui ça semble avoir eu un effet :

root@srvprox1:~# free -h

total used free shared buff/cache available

Mem: 15Gi 7,6Gi 398Mi 886Mi 7,2Gi 6,3Gi

Swap: 8,0Gi 1,5Gi 6,5Gi

Mais pas tant dans les container :

root@srvcloud:~# free -h

total used free shared buff/cache available

Mem: 7,8Gi 1,0Gi 3,8Gi 249Mi 3,0Gi 6,8Gi

Swap: 7,8Gi 565Mi 7,3Gi

Le paramètre dans le container est pourtant aussi à 10 (récupéré du serveur ?) :

root@srvcloud:~# sysctl vm.swappiness

vm.swappiness = 10

Est-ce que la gestion de la SWAP se tripote à un autre endroit sur des containers LXC / proxmox ? Vous faites comment vous ? (ceux qui, comme moi flippe de ne pas mettre de SWAP… parce que je sais que certain n’en utilise pas : https://forum.chatons.org/t/swap-pas-swap-telle-est-la-question/1555 )

Merci pour vos lumières,

David